Ce que tout auteur WordPress doit comprendre en 2026

Il y a encore deux ans, publier un article sur votre site suffisait. Google passait, lisait, indexait. Votre page existait aux yeux du monde. Ce temps est révolu. Depuis le printemps 2025, des milliers de sites voient leurs nouvelles pages ignorées par Google, parfois pendant des semaines, parfois définitivement. Et si vous êtes auteur avec un site WordPress que vous alimentez en ce moment, il y a de fortes chances que vous soyez concerné sans même le savoir.

Ce qui a changé, concrètement

Google croule sous le contenu. Des millions de pages sont publiées chaque jour, dont une écrasante majorité ne présente aucune valeur réelle pour les internautes. Face à cette saturation, le moteur de recherche a opéré un virage majeur : il ne crawle plus tout, il choisit. L’indexation est devenue sélective. Autrement dit, Google décide désormais si votre page mérite d’exister dans ses résultats, et il se montre de plus en plus exigeant.

Les signaux sont visibles dans Google Search Console pour ceux qui la consultent : des URL affichées comme « Explorée, actuellement non indexée » ou « Détectée, non indexée ». Traduction : Google est passé sur votre page, l’a regardée, et a décidé de ne pas la retenir. Pas de bug. Pas d’erreur technique. Un jugement.

Depuis la Core Update de mars 2025, ce phénomène s’est considérablement amplifié. Google a renforcé ses critères autour des E-E-A-T, un acronyme qui résume ce qu’il recherche dans un contenu : Expérience, Expertise, Autorité, Fiabilité. Si votre site ne démontre pas au moins une partie de ces qualités, vos nouvelles pages risquent tout simplement de ne jamais apparaître dans les résultats de recherche.

Pourquoi les auteurs sont particulièrement exposés

Un auteur qui crée son site WordPress pour « avoir une présence en ligne » part souvent avec les meilleures intentions mais les pires habitudes numériques. Quelques pages statiques, une biographie, une liste de livres, un blog mis à jour deux fois par an avec des billets rédigés à la va-vite. C’est précisément le profil que Google sanctionne aujourd’hui.

Voici ce qu’il observe sur ce type de site :

Un contenu rare et peu structuré. Une page publiée tous les trois mois ne génère aucun signal d’activité. Google interprète cela comme un site peu vivant, peu pertinent, peu digne d’être exploré régulièrement.

Zéro maillage interne. Si vos pages ne se relient pas entre elles, Googlebot peut passer sur l’une d’elles sans jamais découvrir les autres. Une page orpheline, c’est une page invisible.

Une autorité de domaine inexistante. Les nouveaux sites ou les sites peu visités souffrent d’un problème de fond : Google n’a aucune raison de leur faire confiance. Il préférera indexer rapidement les pages d’un site établi, reconnu, cité par d’autres, plutôt que celles d’un domaine qu’il ne connaît quasiment pas.

Du contenu sans valeur distincte. « Ma biographie d’auteur », « mes romans policiers », « contact » : des pages que des milliers de sites publient dans des termes quasiment identiques. Google ne voit aucune raison de vous préférer à un autre.

Le piège du contenu généré par IA

Si vous utilisez ChatGPT ou un autre outil pour rédiger vos articles de blog, vos fiches livres ou vos présentations, sachez que Google a considérablement amélioré sa capacité à détecter ce type de contenu. Non pas pour le punir automatiquement, mais pour évaluer s’il apporte quelque chose de réel. Un texte généré, non relu, non enrichi de votre voix ou de votre expérience propre, sera presque systématiquement relégué dans la catégorie « contenu faible ». Il sera exploré, peut-être, mais pas indexé.

La règle est simple et sans appel : si un robot aurait pu écrire exactement la même chose pour n’importe quel autre auteur dans votre genre, Google s’en fiche.

Ce que Google veut vraiment

L’algorithme de 2026 récompense ce qu’on aurait toujours dû faire : du contenu utile, unique, ancré dans une expertise réelle. Pour un auteur, cela peut prendre des formes très concrètes.

Parler de votre processus d’écriture avec précision, pas avec des généralités. Analyser les livres de votre genre avec un regard de lecteur exigeant. Documenter vos recherches, vos erreurs, vos découvertes. Répondre à des questions que vos lecteurs se posent vraiment. Publier régulièrement, même de manière modeste, plutôt que de produire de gros blocs de texte une fois par trimestre.

Ce que Google cherche à identifier, c’est une voix. Quelqu’un qui sait de quoi il parle, qui l’a vécu, qui prend position. Pas un agrégat de phrases bien formées sur « l’importance de la lecture ».

La fréquence de publication : un signal que Google surveille

Publier « de temps en temps » ne suffit plus. Google analyse le rythme d’activité d’un site pour évaluer sa vitalité. Un site qui ne publie rien pendant deux ou trois mois est interprété comme un site en sommeil, voire abandonné, et le crawler réduit mécaniquement la fréquence de ses visites. Le cercle vicieux s’installe : moins vous publiez, moins Google passe, moins vos pages sont indexées.

Le seuil minimal à respecter est une publication par mois, idéalement deux. Ce n’est pas une question de volume : un article solide de 800 mots publié régulièrement vaut infiniment mieux que cinq articles creux publiés en rafale puis plus rien pendant quatre mois. Google ne récompense pas les pics d’activité, il récompense la constance.

Pour un auteur, cela peut prendre des formes légères et naturelles : un billet sur un livre lu récemment, un retour sur une séance de dédicaces, une réflexion sur un aspect de votre genre littéraire. L’essentiel est de maintenir le signal de vie.

Les backlinks : le facteur décisif que personne ne mentionne

L’autorité d’un site ne se construit pas de l’intérieur. Elle se construit depuis l’extérieur, par les liens que d’autres sites font pointer vers le vôtre. C’est ce qu’on appelle les backlinks, et c’est l’un des critères les plus puissants pour convaincre Google que votre domaine mérite d’être pris au sérieux.

Concrètement : si un blog littéraire reconnu, un site de libraire, un magazine culturel ou un média régional publie un article qui renvoie vers votre site, Google enregistre ce signal comme une forme de caution. Quelqu’un de fiable vous cite. Votre autorité monte. Vos pages s’indexent plus facilement et plus rapidement.

Les auteurs ignorent presque systématiquement ce levier, alors qu’il est à leur portée. Être chroniqué sur des blogs spécialisés, mentionné dans des articles de presse, référencé sur des sites de libraires indépendants ou des plateformes culturelles : chaque lien entrant est un vote de confiance aux yeux de Google. Cultivez ces relations, pas uniquement pour la visibilité directe qu’elles apportent, mais parce qu’elles construisent l’infrastructure invisible qui détermine si vos pages seront indexées ou ignorées.

Les réseaux sociaux ne remplacent pas votre site

C’est une erreur très répandue chez les auteurs : concentrer toute leur énergie sur Instagram, Facebook ou TikTok, et traiter leur site WordPress comme une formalité. Les réseaux sociaux donnent de la visibilité, certes, mais ils ne construisent rien qui vous appartienne. Un compte Instagram peut être suspendu du jour au lendemain. Un algorithme peut décider que vos posts n’apparaissent plus dans les fils de vos abonnés. Vous ne contrôlez rien.

Votre site, lui, vous appartient. Et Google, contrairement à Meta ou ByteDance, peut vous envoyer un trafic organique durable, gratuit, et qui cherche activement ce que vous proposez.

Les réseaux sociaux doivent servir à ramener du trafic vers votre site, et non le remplacer. Chaque post, chaque story, chaque vidéo courte devrait idéalement contenir un chemin vers votre domaine. Ce trafic entrant, même modeste, envoie à Google un signal de pertinence : des gens cherchent ce site, des gens y viennent, il vaut la peine d’être indexé.

Les vérifications techniques minimales à faire aujourd’hui

Avant même de travailler votre contenu, assurez-vous que rien ne bloque l’accès de Google à votre site. Plusieurs erreurs courantes passent inaperçues sur WordPress :

Une balise <meta name="robots" content="noindex"> présente par erreur dans vos templates ou dans les réglages de votre thème. Certains thèmes activent cette option par défaut en mode développement et elle n’est jamais désactivée.

Un fichier robots.txt trop restrictif qui interdit à Googlebot d’explorer certaines sections du site.

Un sitemap XML absent, mal configuré ou non soumis à la Search Console.

Des pages importantes non reliées par aucun lien interne, donc invisibles pour le crawler même si elles existent techniquement.

Une vitesse de chargement trop lente, notamment sur mobile, qui pousse Google à déprioritiser le crawl de votre site.

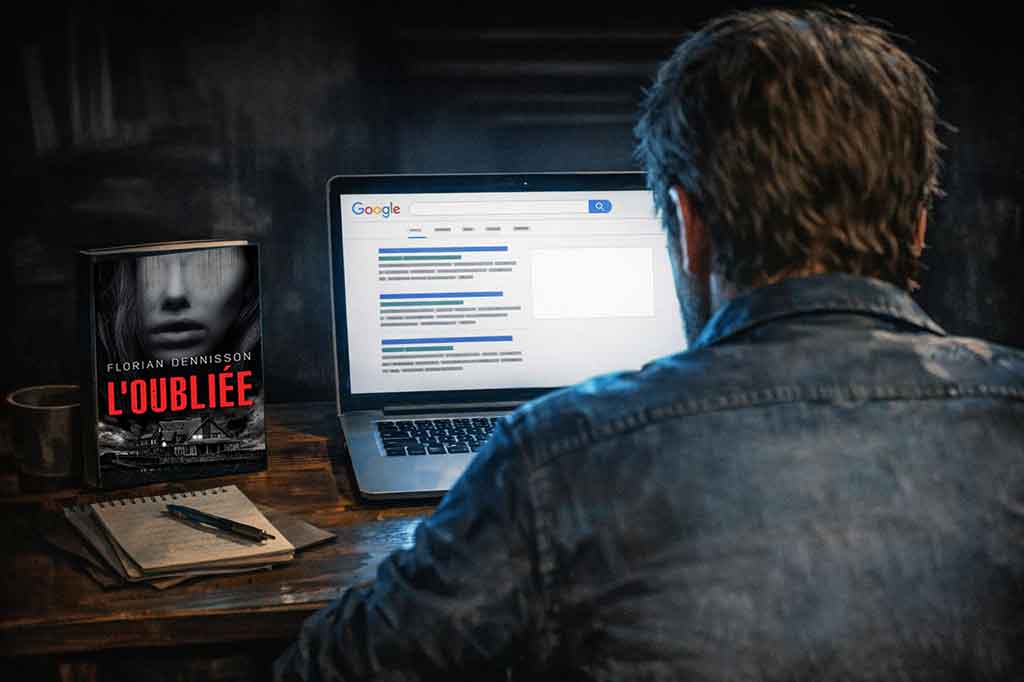

Google Search Console : l’outil que vous n’avez probablement pas installé

Soyons directs : si vous n’avez pas configuré Google Search Console sur votre site, vous pilotez en aveugle. Cet outil gratuit, fourni par Google lui-même, est le seul moyen de savoir précisément ce que le moteur voit de votre site, quelles pages sont indexées, lesquelles sont rejetées et pourquoi.

L’installation prend moins de quinze minutes. Il suffit de créer un compte sur search.google.com/search-console, d’ajouter votre domaine, de valider la propriété via un fichier HTML ou une balise méta, puis de soumettre votre sitemap XML. Une fois en place, vous pouvez utiliser l’outil « Inspection d’URL » pour vérifier le statut de chaque page et demander une indexation manuelle lorsque Google ne passe pas spontanément.

C’est votre tableau de bord de survie. Sans lui, vous ne saurez jamais si Google vous ignore, et vous ne pourrez pas corriger ce qui cloche.

La demande d’indexation manuelle : utile, mais pas suffisante

Google Search Console permet de soumettre une URL manuellement pour demander son indexation. C’est une solution de court terme acceptable, et si vous constatez que vos pages ne s’indexent pas spontanément, vous devriez le faire systématiquement pour chaque nouvelle publication. Mais ne vous y trompez pas : cette démarche ne corrige rien en profondeur. Si Google juge votre contenu insuffisant, il indexera peut-être la page temporairement, puis la retirera de son index quelques semaines plus tard. La seule solution durable, c’est la qualité.

Ce que cela signifie pour votre présence en ligne

Avoir un site WordPress ne suffit plus. Payer un hébergeur et y déposer quelques pages ne vous donne aucune garantie d’exister dans les résultats de recherche. Google est devenu un filtre redoutable, et les auteurs qui traitaient leur site comme une simple carte de visite statique vont continuer à disparaître de la surface visible du web.

La bonne nouvelle, c’est que la solution n’est pas technique. Elle ne nécessite pas de budget, pas de formation avancée en SEO. Elle demande simplement ce que vous savez déjà faire : écrire avec substance, avec régularité, avec une voix qui vous appartient.

C’est exactement pour cela que vous êtes auteur.

A lire aussi

Mots-clés : indexation Google 2026, pages non indexées WordPress, SEO auteur, Google Search Console, contenu de qualité SEO, E-E-A-T Google, indexation sélective, Core Update 2025

Je m’appelle Manuel et je suis passionné par les polars depuis une soixantaine d’années, une passion qui ne montre aucun signe d’essoufflement.